引領全球人工智能熱潮的OpenAI,終於推出了它的新一代多模態模型GPT-4。

新一代模型能夠同時接收圖像和文本輸入,比上一代模型GPT-3.5(ChatGPT的技術基座)參數更多、更安全,“比以往更具創造性和協作性”,並且“由於它有更廣泛的常識和解決問題的能力,可以更準確地解決難題。”

這一次的發佈,也比以往更加神祕,OpanAI沒有公佈GPT-4相關技術細節,標誌着該公司從非營利性研究實驗室向營利性技術公司的全面轉變。

更出色的人工智能

GPT-4在安全性和精確性上都有巨大的提升。

OpenAI稱,GPT-4比GPT-3.5對受限制請求做出迴應的可能性低82%,編造內容的可能性低60%。

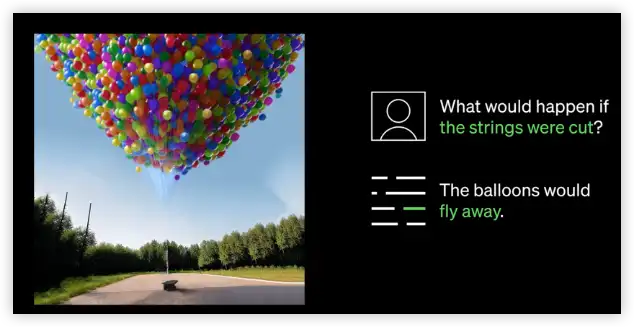

更重要的是,不同於ChatGPT僅能接收文本輸入,GPT-4可以響應圖片。向它展示一張冰箱里東西的照片,然後問它能做什麼飯,GPT-4會嘗試用照片上的原料生成菜譜。

給它一張氣球被線拴在地上的圖片,然後提問如果把線割斷會發生什麼,GPT-4會回答“氣球會飛走”。

此外,OpenAI的新模型在基本推理方面的表現比ChatGPT更好,可以解決更復雜的難題。

據媒體拿到的演示版本,GPT-4能夠用字母“g”開頭的單詞概括OpenAI的公司簡介:

“GPT-4, groundbreaking generational growth, gains greater grades. Guardrails, guidance, and gains garnered. Gigantic, groundbreaking, and globally gifted.”

GPT-4在美國律師執照考試(UBE)上的表現也遠超GPT-3.5,GPT-3.5的得分是倒數10%,而GPT-4是前10%。

AI初創公司Hugging Face聯合創始人Thomas Wolf對媒體稱,理論上,結合文本和圖像的多模態模型能夠更好地理解世界:

“它可能能夠解決語言模型的傳統弱點,如空間推理,”

艾倫人工智能研究所的Oren Etzioni對媒體表示:

“GPT-4現在是評估所有AI模型的基準,它在許多方面的提升都非常顯著。”

一家變味兒的公司

然而,和之前發佈GPT-3、2的時候不一樣,OpenAI這次沒有透露GPT-4有多大,也沒說它是如何打造的——沒有透露數據、計算能力或訓練技術。只是模糊地說,GPT-4的參數更多,是一個更大的模型。

以前,OpenAI會公開這些數據,給同行參考,比如GPT-2有15億個參數,性能更好的GPT-3參數是它的100倍。

Wolf對媒體抱怨道:

“OpenAI現在是一家完全封閉的公司,科學交流類似於產品的新聞發佈,”

競爭變得更加激烈了,Google旗下DeepMind的多模態模型Flamingo在急起直追,其他互聯網巨頭也都正在AI上發力。OpenAI如今是一家背靠微軟、尋求賺錢的營利機構,而不是一家純粹的人工智能研究所了。

GPT-4的早期版本已經在微軟產品中上線。OpenAI還開放了API接口,讓機構商用。目前,已經有支付平臺Stripe、語言學習平臺多鄰國、摩根士丹利和冰島政府(冰島試圖使用GPT-4來保護冰島語言)等多家機構前來尋求合作。

GPT-4的訪問權限將優先提供給註冊過等候名單的用戶以及付費購買ChatGPT會員的用戶,但目前僅限於文本輸入。