您正在浏览的是香港网站,香港证监会BJA907号,投资有风险,交易需谨慎

夜读 | ChatGPT背后

作者:韦青 微软中国CTO

来源:混沌学园

导读

他说,“山中方七日,世上几千年。当你埋头在屋子里面,研究最新技术进展,比如现在的最火的ChatGPT,出门一看,好像满世界的人都把它当成了很新鲜的事情。其实ChatGPT3.0算是一个比较大的突破,但它两年前就有了。它的结构、基本原理也存在很多年了。”

他说,“这轮技术,大概率就是把我们的知识进行提炼……机器是不会想的,想这个词是人类自己发明出来的。如果你硬把这种能力视为“想”,不能说错与对,但它会误导你对机器的判断、理解和定义。”

他说,“Sam Altman(OpenAI CEO)那批人就是坚信大模型大力出奇迹,就能够表征人类的知识,就这么简单。”

ChatGPT的本质是什么?是否将替代人类工作?我们人类又该如何与之共存?

今天,我们邀请韦青老师,微软中国CTO做客混沌。他将利用工程师的底层视角,为大家揭开人工智能的冰山一角,探寻ChatGPT为何全球爆火。

韦青老师说,“大家有没有感觉到,每天好像都是见证时代的一天。由于我们的工作背景,在技术领域、在微软,能看到更多现象,我想跟大家讲,首先看到任何现象,先不用感到惊讶。帷幕刚拉开一角,舞台尚未完全展开。”

01

比真还真的时代

GPT是现在最热门的话题,但GPT3模型两年前就培训出来了。GPT4的出现让人惊艳,但去年8月份它就已经被训练出来了。

什么意思?ChatGPT实际上是冰山一角。当我们看到某些现象出现的时候,某种意义来讲,这件事已经结束了。而这个时代才刚刚开始,ChatGPT现象会层出不穷。

再追逐冰山已经没什么意思了,我们要尽快通过浮起的冰山,去理解我们可能进入了一片冰山丛生的海洋。

从一个本质性的构成来讲,人类对世界的认知已经经历了三个阶段:农业时代是物质构成的。有地、有粮、有人就等于有权力,有生存的空间;工业时代如果你有能源、有动力,比有粮食还具备竞争力;到第三阶段,人类发现信息也是构成世界的一种本源性的存在。思想受什么影响?信息。

无论是麦克卢汉,还是鲍德里亚的理论,都已经强调了信息、电子信息的出现,可能会使人类社会的结构、边界、性质、方式都发生变化。

麦克卢汉最出名的理论是地球村。请想象一下,在父母辈的时代,朋友大部分是单位的同事,来自家族、村子、单位。仅仅过了几十年,现在你的朋友圈还受公司约束吗?

鲍德里亚的观点是,如果人类无止境地或者完全泛滥地利用数字化信息技术,我们很快就会进入一个比真还真的时代,那些由人工智能生成的照片、文字,你觉得它是真的吗?

这几个月太热闹了,或许先不需要这么快下结论。当你埋头在屋子里面,研究最新技术进展,比如现在的最火的ChatGPT,出门一看,好像满世界的人都把它当成了很新鲜的事情。

ChatGPT3.0算是一个比较大的突破,但它两年前就有了。它的结构、基本原理也存在很多年了。

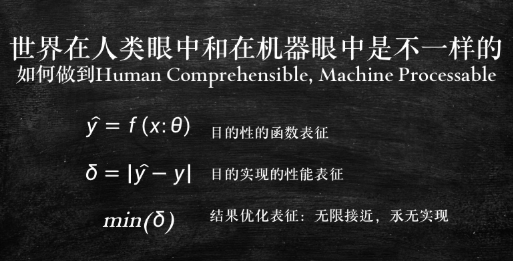

语言是思想的边界,这是维特根斯坦说的,但我要给他再加一句话,技术是思想的实现。

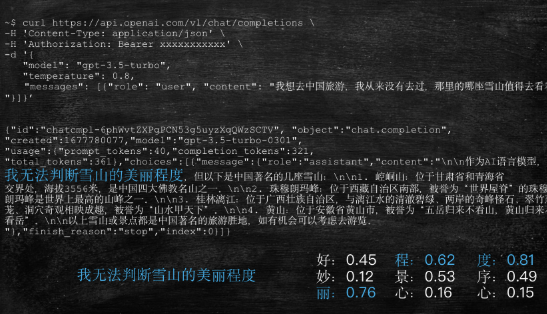

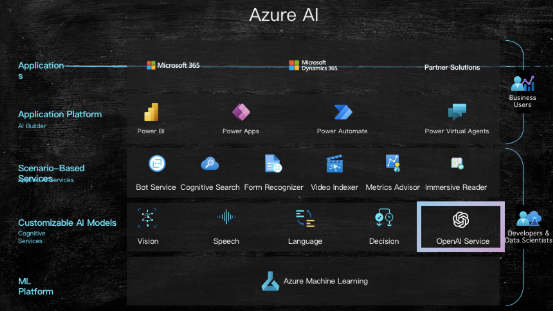

我们忽略了一点,能够把技术开发出来,先得有一个思想。ChatGPT,实际上它只是一种提取已经被沉淀、被记忆的知识的一种交互方式,底下什么?是基础模型。像谷歌的BERT,Facebook的LLaMa。

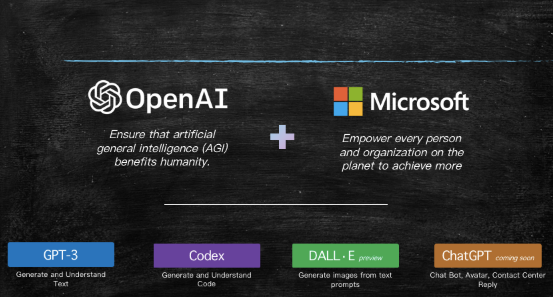

为什么GPT现在那么火?它背后是OpenAI的技术信仰,再加上微软的Satya(微软CEO)、Kevin Scott(微软CTO)这些人的技术信仰的结合。这些人都相信,靠大量的语料和海量的计算,能够产生出对于知识的沉淀和应用。

Sam Altman说,GPT走出的第一步,是拿把人类知识先沉淀下来。就像先把玫瑰花蒸馏成玫瑰精油。

但精油太浓了,你要使用的话,需要调和。所以第二步,就是用Instruct(指令)的方法,用提示词的方法,把精炼的玫瑰精油,滴到沐浴露中去。

但是,这件事没被证明可行之前,某种意义上是完全要靠信仰支撑的事情。有多少人敢这么做?又要花人力、花时间、花海量的金钱,结果可能竹篮打水一场空。某种意义上,它的成功也可以理解成幸存者偏差。

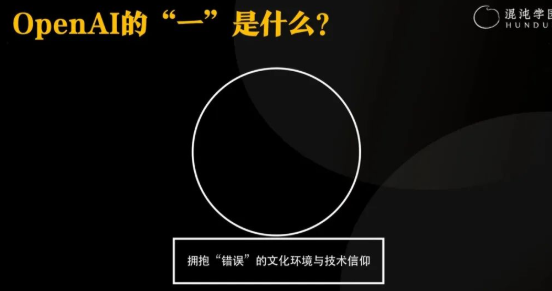

我认为你要赞叹的,不应该是ChatGPT的模型多么伟大,而是它背后耐得住寂寞、怀疑的这种定力、决心、信心,这已经是一种技术信仰了。

我们有没有对于工具、对于数字化技术的技术信仰?这才是我们应该问自己的。

认知达到信仰的层面,才能够选一条没有人走过的路。尽管今天还走不通,但你就认为这条路可以走,因为第一性原理告诉你,这样做是对的,只不过人类的技术还没有发展到那一步,还证明不出来。

另一个例子是SpaceX。它成功了,大家都觉得太牛了。但当马斯克后来接受媒体采访时,他哭了。他说当时我认为火箭可以回收,但NASA、所有大咖级人物、科学家都跟他讲,这条路是走不通的。

OpenAI是一样的,我们认为它在2023年1月忽然出名,怎么可能?它背后有太多的辛酸、坚持、疑惑、摇摆,只不过坚持下来了。 这一轮技术,大概率就是把我们的知识进行提炼。知识哪来的?是我们的所作所为、所写所说,落成的文字、视频、语音,经过数字化之后,被机器去提炼,建成一种模型,变成知识沉淀下来。

为什么大家觉得它很神奇呢?因为没有任何一个人有这种能力,能记住人类所有的知识。

有些人觉得,机器会涌现出一些思想能力。确实,它会表现成思想能力。但如果你知道它的算法是如何做出来的,你还是会形成自己的判断。

我要想先声明一下,每个人都会对这种现象产生不同的解读。我的解读是,现在的机器并不具备真正的思想力,是把人类知识记忆之后的一种使用能力。

机器是不会想的,想这个词是人类自己发明出来的。如果你硬把这种能力视为“想”,不能说错与对,但它会误导你对机器的判断、理解和定义。

4. 做一个思想实验,这轮技术到底是什么?

这一轮技术,大概率就是把我们的知识进行提炼。知识哪来的?是我们的所作所为、所写所说,落成的文字、视频、语音,经过数字化之后,被机器去提炼,建成一种模型,变成知识沉淀下来。

为什么大家觉得它很神奇呢?因为没有任何一个人有这种能力,能记住人类所有的知识。

有些人觉得,机器会涌现出一些思想能力。确实,它会表现成思想能力。但如果你知道它的算法是如何做出来的,你还是会形成自己的判断。

我要想先声明一下,每个人都会对这种现象产生不同的解读。我的解读是,现在的机器并不具备真正的思想力,是把人类知识记忆之后的一种使用能力。

机器是不会想的,想这个词是人类自己发明出来的。如果你硬把这种能力视为“想”,不能说错与对,但它会误导你对机器的判断、理解和定义。

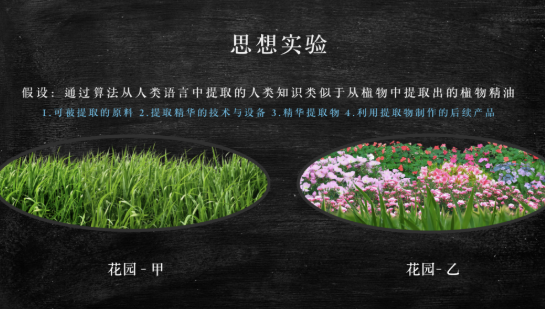

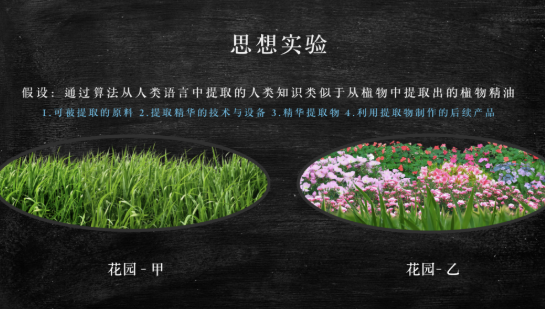

4. 做一个思想实验,这轮技术到底是什么? 如果我们发现了,可以通过蒸馏的方式,从植物中蒸馏出它的油性。请问,花园甲跟花园乙的拥有者,做同样的事情,最后的价值会是怎样的?他们做出来的东西,对社会的影响力会大不相同。

花园甲的拥有者,会怀疑提纯机器不行?还是会痛定思痛,发现原料有问题?

当我们从农业文明进入工业文明,已经受过很多降维打击了。当物质、能量变成信息的时候,会带来更加降维式的打击。

这种竞争方式,已经不是技术能力的竞争,有钱没钱的竞争……而是文明在一较高低。

你的文明所表现的形式,能否被新一代的会思考的机器学到、吸收到,并且让它的行为方式对你有利?

ChatGPT刚火的时候,知乎股价飞涨。在中国,具备语言语料的网站绝对不止知乎。为什么它涨得那么厉害?我没做过详细统计,但我认为,知乎的花园可能类似于花园乙。

我们再扪心自问下,贵公司、贵机构、贵组织,你们的知识的表现形式、呈现方式,更像是左边还是右边?你未来如何跟具备这样能力的公司竞争?

如果你的信息,无法沉淀成能被机器学习的知识。这一轮的机器能力,你能够利用到的概率就大为降低。

如果我们发现了,可以通过蒸馏的方式,从植物中蒸馏出它的油性。请问,花园甲跟花园乙的拥有者,做同样的事情,最后的价值会是怎样的?他们做出来的东西,对社会的影响力会大不相同。

花园甲的拥有者,会怀疑提纯机器不行?还是会痛定思痛,发现原料有问题?

当我们从农业文明进入工业文明,已经受过很多降维打击了。当物质、能量变成信息的时候,会带来更加降维式的打击。

这种竞争方式,已经不是技术能力的竞争,有钱没钱的竞争……而是文明在一较高低。

你的文明所表现的形式,能否被新一代的会思考的机器学到、吸收到,并且让它的行为方式对你有利?

ChatGPT刚火的时候,知乎股价飞涨。在中国,具备语言语料的网站绝对不止知乎。为什么它涨得那么厉害?我没做过详细统计,但我认为,知乎的花园可能类似于花园乙。

我们再扪心自问下,贵公司、贵机构、贵组织,你们的知识的表现形式、呈现方式,更像是左边还是右边?你未来如何跟具备这样能力的公司竞争?

如果你的信息,无法沉淀成能被机器学习的知识。这一轮的机器能力,你能够利用到的概率就大为降低。

02

机器文明,冰山一角

时代的巨变有个好处,不管你多么先进,多么落后,在这个时代又拉平了。

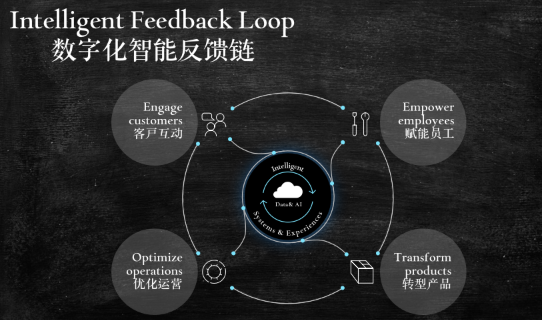

微软CEO Satya说的刷新,Hit Refresh就是此意,重来过一遍。在这一轮的技术潮流下,我们如何重新获得定位?需要我们每一个人思考。

1. 冲着ChatGPT创新,等于拎包入住而没有自己的地基

古人有一句话叫“圣人畏因,凡人畏果。” 有了理念、信仰、追求,才能产生结果,如果我们只抓着结果,很容易只见树木、不见森林。

拿ChatGPT来举例子。当我们看到这个技术结果的时候,要相信它不是从石头里蹦出来的。

2023年1月,微软CEO Satya和Sam Altman(OpenAI CEO)的合照在网上很火,他们跟大家介绍了双方的合作和技术的进步。但其实在2016年,双方已经开始探讨了。 OpenAI的成长,也是在不断摸索的。大家可以看一本书,《深度学习革命》,以OpenAI这批人为代表的深度学习实践者和探索者们,怎样从当初对谷歌人工智能产生一些担忧,到成立这间公司。一切都是有脉络可循的,是几十年的摸索、试错,才走到今天这一步的。

如果我们冲着GPT的模型去了,从创新的角度来讲,我把它称之为拎包入住。

大家想象一下,一片未开垦的土地,长满杂草茂木。但有人把它开垦出来了,又根据土地的特点,设计出人类能够居住的房屋,把楼给造起来了,再找一些设计师精装修。最后招商引资。

这时我们都看到了趋势,发现只要找个50层以上的公寓房做生意就能够大赚特赚,就拎包入住了。当时确实大赚特赚了。但若干年之后,文明变了,潮流变了,50层以上的房屋不受欢迎了,你怎么办?

OpenAI有很多算法,很多工具,它曾经在机器人上投资,现在有人去看它的机器人吗?ChatGPT只是它在众多的尝试中,凑巧发现了一条路可以往前走。你要跟着它这条路走,有点像守株待兔,认为兔子永远会撞在这棵树上。

我认为,其实各位可以在这一轮,去看OpenAI的理念,最早这些人是怎么想的、怎么做的、愿景是什么。

拿ChatGPT举例,它下层有两类支柱,产物、产出它的人。别只关注ChatGPT或GPT4,去看更深层的东西。

一方面是大语言模型,赖以沉淀人类所有的知识,或者是能够被它学习到的所有知识的机制。是Transformer/RNN/CNN/LSTM,是用数学的方式,表征物理世界和人类知识与行为的特征。

另一方面,OpenAI,也是由人构成。公司就是由一批志同道合者构成的一个组织,去完成一个共同的愿景,共同的一个目标。

这些人才是一批有科学修养的,又有工程实现能力的,又对语言学、计算机科学的第一性原理有深刻理解的。更关键的是,有一个共同的理想,坚信做这件事是对的,是有用的。

其实有很多人正因为OpenAI所谓的成功,反而离开了,因为觉得愿景不一样了。这是它的人才特征。

人才特征的背后又是什么?容错、合作、开放的文化,不拘一格降人才的用人风格,配合的风格,彼此交流的风格。

如果我们连办公场所都严格要求,老板、员工分级坐,等级森严,是很漠然的群体,有可能做成这件事吗?

我自己也是管理者,感触还蛮深的。各个企业的文化真的不一样。有开放的、有封闭的、有严厉的、有宽松的、有说一套做一套的,有说知行合一的,所处的行业特征,社会的氛围也真的是不一样的。

错误是成功的前提条件。你公司的环境,整个的社会大环境,允许不允许这种容错文化的出现?

OpenAI的成长,也是在不断摸索的。大家可以看一本书,《深度学习革命》,以OpenAI这批人为代表的深度学习实践者和探索者们,怎样从当初对谷歌人工智能产生一些担忧,到成立这间公司。一切都是有脉络可循的,是几十年的摸索、试错,才走到今天这一步的。

如果我们冲着GPT的模型去了,从创新的角度来讲,我把它称之为拎包入住。

大家想象一下,一片未开垦的土地,长满杂草茂木。但有人把它开垦出来了,又根据土地的特点,设计出人类能够居住的房屋,把楼给造起来了,再找一些设计师精装修。最后招商引资。

这时我们都看到了趋势,发现只要找个50层以上的公寓房做生意就能够大赚特赚,就拎包入住了。当时确实大赚特赚了。但若干年之后,文明变了,潮流变了,50层以上的房屋不受欢迎了,你怎么办?

OpenAI有很多算法,很多工具,它曾经在机器人上投资,现在有人去看它的机器人吗?ChatGPT只是它在众多的尝试中,凑巧发现了一条路可以往前走。你要跟着它这条路走,有点像守株待兔,认为兔子永远会撞在这棵树上。

我认为,其实各位可以在这一轮,去看OpenAI的理念,最早这些人是怎么想的、怎么做的、愿景是什么。

拿ChatGPT举例,它下层有两类支柱,产物、产出它的人。别只关注ChatGPT或GPT4,去看更深层的东西。

一方面是大语言模型,赖以沉淀人类所有的知识,或者是能够被它学习到的所有知识的机制。是Transformer/RNN/CNN/LSTM,是用数学的方式,表征物理世界和人类知识与行为的特征。

另一方面,OpenAI,也是由人构成。公司就是由一批志同道合者构成的一个组织,去完成一个共同的愿景,共同的一个目标。

这些人才是一批有科学修养的,又有工程实现能力的,又对语言学、计算机科学的第一性原理有深刻理解的。更关键的是,有一个共同的理想,坚信做这件事是对的,是有用的。

其实有很多人正因为OpenAI所谓的成功,反而离开了,因为觉得愿景不一样了。这是它的人才特征。

人才特征的背后又是什么?容错、合作、开放的文化,不拘一格降人才的用人风格,配合的风格,彼此交流的风格。

如果我们连办公场所都严格要求,老板、员工分级坐,等级森严,是很漠然的群体,有可能做成这件事吗?

我自己也是管理者,感触还蛮深的。各个企业的文化真的不一样。有开放的、有封闭的、有严厉的、有宽松的、有说一套做一套的,有说知行合一的,所处的行业特征,社会的氛围也真的是不一样的。

错误是成功的前提条件。你公司的环境,整个的社会大环境,允许不允许这种容错文化的出现? 我说如果你要做一个ChatGPT,个人的建议,还是别玩这个游戏了。就像是打冰球,追着冰球打太难了,你最好天天求什么?求前面没人打了。但那时,新的赛道又开出来了。天天在说弯道超车,等你真超过去才发现,前面已经没车了。

新开辟一条道路,需要建立这种环境,建立这种文化,培养这种人才,这才是最基本的。Sam Altman那批人就是坚信大模型大力出奇迹,就能够表征人类的知识,就这么简单。

通用人工智能(AGI)是他们的追求。OpenAI会为之付出无穷的努力,不懈的追求,直到证明它绝对不行了。只不过,很巧它成了。但就算在AGI上,大家的关注点,也都各有侧重。

20年前谷歌刚成立的时候,只是个搜索引擎。你会感到很无厘头,一个搜索引擎,为什么把不作恶作为标准?现在大家明白了吧,在一个“比真还真的时代”,给你的信息当然可以作恶。

AI也一样。微软明确指出要做负责任的AI,谷歌说的叫不作恶。OpenAI提出UBI,全民基本收入(UBI,是指“无条件”地为所有个人定期发放一笔现金收入)。

Sam Altman在采访中说,需要新思想回答的三个问题是:如何分配通用人工智能产生的利润?如何分享通用人工智能的访问权?如何分担通用人工智能的治理权?

大家想一想,为什么Sam Altman想到了这三个问题?

还是因为AGI一旦推出来,大家马上就会发现,它的能力太大了,如果不能让人类在这三个问题上达成共识,有人赚便宜、有人吃亏,就产生动荡的因素了。AGI带来的这些议题,需要我们去了解。

建议大家看一下《大都会》这部电影。它1927年上映,到现在马上100年了,你会发现,我们几乎在重演历史。

我说如果你要做一个ChatGPT,个人的建议,还是别玩这个游戏了。就像是打冰球,追着冰球打太难了,你最好天天求什么?求前面没人打了。但那时,新的赛道又开出来了。天天在说弯道超车,等你真超过去才发现,前面已经没车了。

新开辟一条道路,需要建立这种环境,建立这种文化,培养这种人才,这才是最基本的。Sam Altman那批人就是坚信大模型大力出奇迹,就能够表征人类的知识,就这么简单。

通用人工智能(AGI)是他们的追求。OpenAI会为之付出无穷的努力,不懈的追求,直到证明它绝对不行了。只不过,很巧它成了。但就算在AGI上,大家的关注点,也都各有侧重。

20年前谷歌刚成立的时候,只是个搜索引擎。你会感到很无厘头,一个搜索引擎,为什么把不作恶作为标准?现在大家明白了吧,在一个“比真还真的时代”,给你的信息当然可以作恶。

AI也一样。微软明确指出要做负责任的AI,谷歌说的叫不作恶。OpenAI提出UBI,全民基本收入(UBI,是指“无条件”地为所有个人定期发放一笔现金收入)。

Sam Altman在采访中说,需要新思想回答的三个问题是:如何分配通用人工智能产生的利润?如何分享通用人工智能的访问权?如何分担通用人工智能的治理权?

大家想一想,为什么Sam Altman想到了这三个问题?

还是因为AGI一旦推出来,大家马上就会发现,它的能力太大了,如果不能让人类在这三个问题上达成共识,有人赚便宜、有人吃亏,就产生动荡的因素了。AGI带来的这些议题,需要我们去了解。

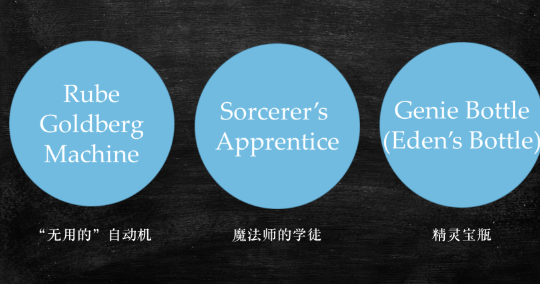

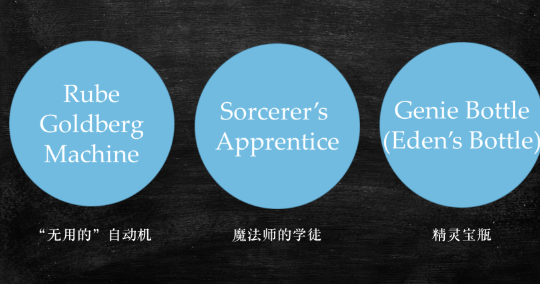

建议大家看一下《大都会》这部电影。它1927年上映,到现在马上100年了,你会发现,我们几乎在重演历史。 1)无用的机器。出现了过度设计的无用的自动机。仔细想一想,它每一个理念,每一个精巧的激发过程和动作,是不是我们现在人工智能、机器人的思想的底蕴?

那么,我们有没有可能在不接受,甚至排斥“无用的自动机”前提下,鼓励工程师,孩子们去创造出这种自动机的文明?当不被鼓励、允许时候,他们有没有可能去做自动化的事儿?

我再举个例子,我们这个文明是不接受多米诺骨牌有任何价值的。但实际上,多米诺骨牌跟无用的自动机,背后都有一个隐含的、对于自动机的一种强烈的发自内心的追求。人工智能没成功前的所有投入,都是无用的自动机。这就是我们要深思的。

2)魔法师的学徒。名字来源于歌德的戏剧,它在全球技术领域经常被引用,说人类在开创一些魔法式的技术,但魔法需要被制衡,开启魔法以外,要会关。

3)精灵宝瓶。你不但要关掉魔法,还得把它收回去。留在世上可能也会有问题。

《大都会》结尾有一句经典名言,说在负责思考、筹划的大脑跟执行任务的双手之间,必须有一个调节者,这个调节者必须是人心。

我想说,当你为ChatGPT激动不已,脑补着很多东西的时候,有些议题其实已经被思考100多年了。而且,还没有定论。一两百年过去了,大家仍然在探讨自动机的普遍流行造成的后果,和相应的人文上的制约。

这就是盖子揭开之后,人类所面临的话题。这是远比所谓的人工智能奇异点,更宏大、更深刻、更严峻的话题。

1)无用的机器。出现了过度设计的无用的自动机。仔细想一想,它每一个理念,每一个精巧的激发过程和动作,是不是我们现在人工智能、机器人的思想的底蕴?

那么,我们有没有可能在不接受,甚至排斥“无用的自动机”前提下,鼓励工程师,孩子们去创造出这种自动机的文明?当不被鼓励、允许时候,他们有没有可能去做自动化的事儿?

我再举个例子,我们这个文明是不接受多米诺骨牌有任何价值的。但实际上,多米诺骨牌跟无用的自动机,背后都有一个隐含的、对于自动机的一种强烈的发自内心的追求。人工智能没成功前的所有投入,都是无用的自动机。这就是我们要深思的。

2)魔法师的学徒。名字来源于歌德的戏剧,它在全球技术领域经常被引用,说人类在开创一些魔法式的技术,但魔法需要被制衡,开启魔法以外,要会关。

3)精灵宝瓶。你不但要关掉魔法,还得把它收回去。留在世上可能也会有问题。

《大都会》结尾有一句经典名言,说在负责思考、筹划的大脑跟执行任务的双手之间,必须有一个调节者,这个调节者必须是人心。

我想说,当你为ChatGPT激动不已,脑补着很多东西的时候,有些议题其实已经被思考100多年了。而且,还没有定论。一两百年过去了,大家仍然在探讨自动机的普遍流行造成的后果,和相应的人文上的制约。

这就是盖子揭开之后,人类所面临的话题。这是远比所谓的人工智能奇异点,更宏大、更深刻、更严峻的话题。

03

如何利用机器?

“教-学”相长,“有-用”相随

人和机器的关系是什么?比较理想的状况,是由机器弥补人类的弱点。那么,首先机器的优点、弱点是什么?人类的优点、弱点是什么?我们知道吗?

第二,人类怎么指挥机器?机器怎么能够被指挥?怎么能够不被指挥?我们考虑过吗?

第三,教学相长。我们要明白它是怎么学的,才能明白怎么去教它。

1. “教-学”相长

这点我特别希望想跟大家强调一下。否则,我们会误以为机器真能凭空学到知识。

关注uSMART

重要提示及免责声明

盈立证券有限公司(“盈立”)在撰写这篇文章时是基于盈立的内部研究和公开第三方信息来源。尽管盈立在准备这篇文章时已经尽力确保内容为准确,但盈立不保证文章信息的准确性、及时性或完整性,并对本文中的任何观点不承担责任。观点、预测和估计反映了盈立在文章发布日期的评估,并可能发生变化。盈立无义务通知您或任何人有关任何此类变化。您必须对本文中涉及的任何事项做出独立分析及判断。盈立及盈立的董事、高级人员、雇员或代理人将不对任何人因依赖本文中的任何陈述或文章内容中的任何遗漏而遭受的任何损失或损害承担责任。文章内容仅供参考,并不构成任何证券、金融产品或工具的要约、招揽、建议、意见或保证。

投资涉及风险,证券的价值和收益可能会上升或下降。往绩数字并非预测未来表现的指标。

轻松入门

投资财富增值

开户

轻松入门

投资财富增值

开户